Les sciences du hasard

Les probabilités

La théorie des probabilités

Qu'est ce qu'est une probabilité ?

Bien que la notion de "probabilité" soit assez triviale, la définir précisément est assez complexe (comme pour un axiome). En mathématiques pure, une probabilité représente une quantité de possibilités (entre 0 et 1) qu'une chose (ici nommé un évènement) étudiée se passe. Cette quantité de possibilités peut aussi être appelée "chance" (ou "risque" selon le contexte), et peut s'exprimer en une valeur entre 0 et 100, nommé un pourcentage, en multipliant la valeur entre 0 et 1 par 100 (une simple remise à l'échelle). Pour étudier des probabilités, il faut étudier un objet qui pourra y faire face. Pour cela, nous allons définir ce que l'on appelle un espace de probabilité. Pour commencer, un espace de probabilité comprend un ensemble d'évènements possibles, nommé un univers.

Pour compléter notre espace, nous allons lui ajouter la possibilité d'effectuer un évènement aléatoire, dans ce que l'on appelle une mesure, présentée plus loin. Le fait de prendre aléatoirement un des évènements (définis dans la tribu) de l'univers est nommé une expérience (ou épreuve) aléatoire. Cet espace est ainsi nommé espace probabilisé.

En mathématiques, la théorie qui étudie les probabilités est nommée la théorie des probabilités. En réalité, cette théorie est assez récente (fin du 19ème siècle), bien que le concept soit vieux de plusieurs millénaires. Dans cette théorie, nous pouvons compter 3 axiomes principaux, introduits par le soviétique Andreï Nikolaïevitch Kolmogorov (1903 - 1987). Premièrement, le premier axiome pose qu'une probabilité ne peut être que entre 0 et 1. Le deuxième axiome dit que la probabilité que l'évènement soit dans l'univers de définition est (en toute logique) de 1, dont une certitude. Le troisième est un peu plus complexe. Il établi que la somme de toutes les probabilités des évènements incompatibles d'une tribu quelconque de l'univers est égale à la probabilité qu'un évènement soit dans cette tribu (et donc, égale à 1).

La théorie de la mesure

Qu'est ce qu'est une mesure ?

En mathématiques, une mesure est une application attribuant une valeur numérique à chaque éléments définis dans une tribu (et donc, dans l'univers). Elle est donc indissociable du concept d'espace mesurable.

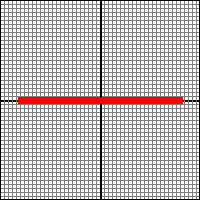

La mesure est donc la valeur maximale possible de cette mesure. Si cette valeur maximale est de 1, alors la mesure respecte les axiomes de probabilités : on parle ici d'espace probabilisé. Donc, chaque évènement à une valeur inférieure ou égale à 1. Il existe des cas (qui, en réalité, sont assez évidents) où cette valeur maximale n'est pas 1. Par exemple, imaginez un plan 2D fini, et une figure sur ce plan.

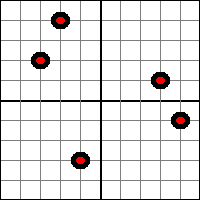

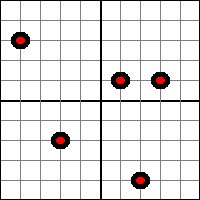

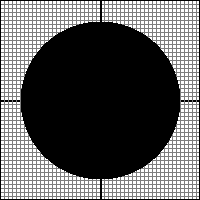

Vous pouvez définir l'ensemble des points sur ce plan comme un ensemble (indénombrable et continu) de vecteurs. De plus, vous pouvez créer une tribu contenant au moins deux éléments : l'ensemble des points dans la figure et l'ensemble des points hors de la figure. Vous avez donc un espace mesurable, que nous allons étendre en espace probabilisable (et donc, que la mesure de tout l'espace soit de 1) pour des raisons de clareté. Grâce à ça, vous pouvez définir une mesure sur cet espace, et donc lui donner une valeur correspondant à la probabilité qu'un point tiré au hasard soit dans cette figure : cela correspond en réalité à l'aire de la figure, en unité d'aire du plan. Avec cette logique, vous pouvez définir n'importe quel mesure de ce genre : longueur, aire, volume...

Certains ensembles appartenant à la tribu peuvent avoir une mesure nulle : la sous-partie de l'ensemble de base correspondant à la tribu de mesure nulle est dite négligeable. De plus, une mesure est dite complète si tous les éléments négligeables via la mesure possibles dans l'ensemble de départ de l'espace mesuré sont aussi dans la tribu de l'espace.

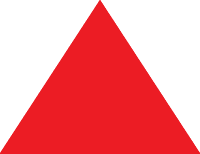

Les fonctions mesurables

Le terme de fonction mesurable est utilisée pour définir des transformations sur des espaces mesurables. Une fonction mesurable est une fonction transformant un ensemble d'une espace mesurable "E" vers un autre ensemble, d'un autre espace mesurable "F". Cette transformation implique une gestion précise des tribus de ses espaces mesurables : la tribu (sur "F") de l'espace mesurable obtenu doit être inclu dans la tribu (sur "E") du premier espace mesurable. Si le nouvel espace est une espace mesuré (et donc que l'espace de départ l'est aussi, en toute logique), la mesure du second espace est nommée mesure image (ou mesure de Lebesgue). Une utilité pratique de ces fonctions et, pour un ensemble de départ représentant un plan 2D (comme vu plus haut) et en tribu son ensemble des parties (l'ensemble de toutes les formes possibles dans le plan), la fonction représentant une forme précise quelconque (triangle, cercle...) sous forme d'espace mesurable dans cet espace.

L'intégrale de Lebesgue

Le concept de fonction mesurable (et de mesure de Lebesgue) permet d'en définir un autre assez pratique : l'intégrale de Lebesgue. En effet, l'intégrale de Lebesgue représente une généralisation de l'intégrale de Riemann. Pour rappel, l'intégrale de Riemann se base sur une technique de traçage via la somme de l'aire de rectangles pour trouver l'aire sous la courbe d'une fonction.

Cependant, cette technique implique que la fonction possède une primitive et une forme très précise, ce qui n'est pas toujours le cas : l'intégrale de Lebesgue fixe se problème. En effet, l'intégrale de Lebesgue rend possible les intégrations de fonctions mesurables en utilisant une mesure de Lebesgue. Donc, la simple existence et finité de la fonction sur son ensemble de définition la rend intégrable via cette forme d'intégrale. Par exemple, la fonction de Dirichlet n'est pas Riemann-intégrable, mais est Lebesgue-intégrable (une intégrale qui vaut 0 en tout point). En fait, il s'agit surtout d'un changement de stratégie dans le calcul des intégrales, donnant des résultats similaires pour les fonctions Riemann-intégrable.

Les lois de probabilités

Étudier des probabilités

Les variables aléatoires

Certains espaces probabilisésne sont pas intéressant à étudier tout seul. Cependant, nous pouvons déduire un nouvel espace probabilisé via un ancien, grâce à ce que l'on appelle une variable aléatoire. En effet, une variable aléatoire "X" est une fonction associant à un élément (d'un espace probabilisé existant) une probabilité d'un autre espace probabilisé(qui est, au minimum, inclu dans l'ancien espace probabilisé). D'un point de vue direct, cette définition peut paraitre abstraite, mais elle implique des concepts très utiles. Par exemple, vous pouvez définir un espace probabilisé d'un dé (comme vu plus haut), avec une tribu contenant deux élément : valeur supérieure ou inférieur à 3,5. Via une variable aléatoire, vous pouvez directement utiliser cette espace, pour le cas où nous avons besoin d'une tribu avec d'autres éléments, comme "valeur paire ou impaire", ou "valeur 1 ou pas 1".

Nous pouvons utiliser cette variable aléatoire "X" avec la mesure de l'ancien espace probabilisé. Dans ce cas, cette mesure est nommée la loi de probabilité de X. En général, si "P" est la mesure de l'ancien espace probabilisé, elle se note comme ça :

Dans certains cas, nous avons une variable aléatoire quelconque, qui ne contient qu'un nombre fini (ou dénombrable) de possibilités : ces lois sont dites "discrètes". Par exemple, les lois que nous pouvons définir via notre dé vu plus haut sont discrètes ("valeur supérieure ou inférieur à 3,5" a 2 possibilités, "valeur paire ou impaire" a aussi 2 possibilités...). Une épreuve se passant sur espace probabilisé offrant deux évènements possibles est nommée une épreuve de Bernoulli. En général, une de ces propabilités est appelée "succès" de probabilité "p", et l'autre est appelée "échec" de probabilité "p - 1".

Différentes méthodes existent pour représenter une loi de probabilité. Si l'univers / la tribu représente un ensemble de nombre (réel, naturel, relatif...) fini ou infini, nous pouvons représenter la loi sous la forme d'une courbe, nommée courbe de densité. En fait, la courbe de densité d'une loi est la correspondance entre un élément de la tribu est et sa probabilité. Si la loi est discrète, cette courbe peut être représentée avec un simple histogramme.

Cependant, si la loi est continue (avec une tribu de réels), alors nous devons la représenter avec une fonction. Dans ce cas, la probabilité que "x" se trouve entre deux valeurs "a" et "b" est l'intégrale de la fonction entre "a" et "b".

Espérance

Si vous avez une loi de probabilité réelle quelconque, et que vous répétez une épreuve beaucoup de fois, la moyenne de toutes les valeurs obtenus représente un nombre bien précis : l'espérance de la loi de probabilité. Comme son nom l'indique, il s'agit d'une quantification de la valeur moyenne que vous pouvez espérer avec cette loi de probabilité après un grand nombre d'épreuves. Dans un ensemble dénombrable de valeur (donc, par exemple, N ou un sous-ensemble de N), cette valeur vaut simplement la somme de toutes les valeurs possibles par la tribu, multipliée par la somme des probabilités des valeurs de la tribu. Cependant, si la tribu de la loi n'est pas bornée, alors ce calcul devient faux, et l'espérance de la loi ne peut pas être définie correctement. Si la loi est indénombrable, alors le calcul est le même, mais nous utilisons une intégrale à la place d'une somme (et l'exception est la même : la tribu doit être bornée).

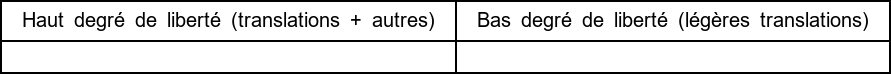

Les processus aléatoires

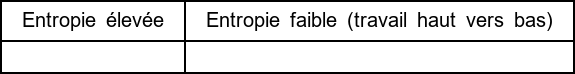

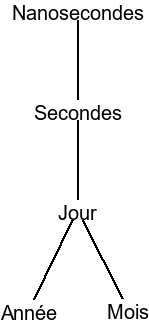

Les lois de probabilités peuvent être modifiées en même temps que les évènements de leur tribu arrivent. L'objet décrivant les variations d'une variable aléatoire dans le temps est nommé un processus aléatoire (ou processus stochastique). Pour décrire cela, nous avons besoin de deux objets spéciaux. Premièrement, nous allons définir un ensemble "S" de valeurs correspondant à toutes les valeurs possibles de la variable aléatoire étudiée. Pour être précis, nous n'étudions pas qu'une seule variable aléatoire, mais une famille, définie dans "S". Cet ensemble contenant toutes les valeurs possibles de la famille de variables aléatoires étudiées est nommé ensemble d'état. En suite, nous allons indexer ces variables, avec des valeurs définies dans un autre ensemble "T", nommé ensemble d'indice. En toute logique, il y'a équipotence entre ces deux ensembles.

L'application / la fonction permettant de prévoir (de manière plus ou moins précise) les variations des variables aléatoires étudiées au fil des épreuves est nommée la trajectoire du processus. Selon les caractéristiques de cette application, le processus peut être étudié de pleins de manières différentes. Si l'ensemble "T" est dénombrable, le processus est aussi dit dénombrable, et si "T" est indénombrable, le processus est dit "continu".

Les statistiques

Étudier des données

Qu'est ce que sont les statistiques ?

Dans tous les domaines en ayant besoin (donc, beaucoup, vraiment beaucoup), les statistiques représentent les ensembles de méthodes utilisées pour étudier des données. Ici, ces mêmes données peuvent être absolument n'importe quoi : un nombre, des textes, des images... Elle représente une des composantes de la récentes discipline de la science des données, étudiant encore plus précisément les données.

Bien qu'elles représentent une branche des mathématiques, cette discipline apparait dans plein de concepts différents. Par exemple, elle est utilisée en démographie pour recenser / sonder la population d'un pays / région / tout ce que vous voulez. En mathématiques, elle est représentée de façon abstraite, pour coller à tous les domaines possibles. Elle englobe donc une grande quantité de sous-domaines différents, propre à des applications plus précises. En général, la part des statistiques permettant de représenter complétement un ensemble de données est nommée "statistiques descriptives" (ou "analyse des données"). Dans ce cas, il est judicieux d'analyse l'entiereté de l'ensemble, pour avoir les résultats les plus réalistes possibles. Cependant, dans certains cas, étudier l'entiereté de l'ensemble est impossible. Si nous ne pouvons pas étudier tout l'ensemble, alors nous allons étudier une partie de cet ensemble (nommé un échantillon), et utiliser d'autres outils statistiques pour en déduire les paramètres de l'ensemble : il s'agit des statistiques mathématiques. Cette branches des statistiques est très liée à la branche mathématiques des probabilités.

Les domaines des statistiques

Caractérisons bien tous les domaines couverts par cette discipline. Elle prend en compte la collecte des données, nommée l'enquête statistique. Par exemple, dans le cadre de la réalisation de statistiques sur des opinions politiques, cette étape consiste à appeler des gens, et leur demander leur avis. Cette partie implique la mise en place de données précises à étudier, et de protocoles pour efficacement étudier ces données. Les données nécessaires sont récoltés parmi un ensemble d'objets de bases, pouvant représenter pleins de choses selon le contexte (population humaine / animal, mesures...). Si tous les objets de l'ensemble sont traités, alors on parle de recueillement, et à l'inverse, si qu'une partie des données est traitée, on parle de sondage. Dans certains cas, cette étape peut rencontrer un imprévu, et fausser une données obtenue (avis mal-exprimé, problème de calibrage) : ce genre de problèmes s'appellent une erreur statistique.

Dés que vous avez vos données brutes, l'idée suivante est de les traiter, pour pouvoir les étudier plus efficacement : c'est le traitement des données. Cette étape dépend beaucoup du contexte de l'étude menée. En général, l'idée est de les représenter graphiquement, pour les rendre plus simple à étudier. Une des représentations graphiques possibles est l'histogramme : représenter une donnée et un nombre attribué (comme, par exemple, l'occurence de la donnée dans l'ensemble des données de départ) sous forme de barres verticales.

Une dernière étape, souvent la plus controversé, arrive : l'interprétation des données. En effet, si vous faites une expérience, c'est (en général)... qu'elle sert à quelque chose. L'interprétation des données permet de développer des conclusions à partir des données traitées.